Hacking the Data Centre

Wie het ontwerp van een op Open Compute-principes gebaseerd datacenter bekijkt, ziet direct dat de infrastructuur veel eenvoudiger en overzichtelijker is dan bij een klassiek ontworpen faciliteit.

Dat heeft alles te maken met de behoefte om met (veel) minder mensen (veel) meer IT-apparatuur te beheren. Maar eenvoud komt ook het energieverbruik ten goede. Om nog maar te zwijgen van de betrouwbaarheid. Waarom chillers gebruiken als we het design zo kunnen aanpassen dat we met veel hogere temperaturen kunnen werken? En waarom nog UPS’en toepassen - zeker als we weten dat deze noodstroomvoorzieningen zo’n belangrijke bron van storingen in datacenters zijn.

De non-profit organisatie Open Compute Project is opgericht in 2011. Dit gebeurde nadat een aantal van ‘s werelds grootste datacenter-gebruikers bij elkaar waren gekomen en hadden besloten om hun eigen hardware designs als open source vrij te geven. Het gaat daarbij om servers, storage, netwerkapparatuur, maar ook tal van componenten die thuis horen in de technische infrastructuur van een datacenter. Het doel van OCP is om met geheel nieuwe ideeën te komen voor het ontwerp en het functioneren van dit soort apparatuur. Zodat deze systemen efficiënter zijn, flexibeler en bovendien meer schaalbaar dan de standaard off-the-shelf producten die de industrie tot nu toe heeft ontwikkeld.

Het resultaat is dat tal van standaard oplossingen en werkmethoden (’zo doen we het nu eenmaal al jaren’) binnen de OCP-wereld zijn vervangen door nieuwe oplossingen die de gebruiker veel meer vrijheid geeft. Maar ook meer mogelijkheden om oplossingen op maat van de eigen problemen te gebruiken, terwijl tegelijkertijd de kosten omlaag gaan.

OCP en CORD

Veel mensen hebben de opkomst van OCP als zeer disruptief ervaren. In eerste instantie ging het vooral om de datacenter-industrie, waar de internet-scale datacenters inmiddels vol staan met vele miljoenen op OCP-principes gebaseerde servers. Maar inmiddels is de OCP-trend ook overgeslagen naar de wereld van de telecom-aanbieders.

In 2016 heeft een aantal telco’s het initiatief genomen tot het oprichten van het zogeheten ‘OCP Telco Project’. Deze partijen zijn nu bezig om hun grote telefooncentrales (in het Engels ook wel ‘central offices’ genoemd) om te vormen tot op OCP gebaseerde en volledig gevirtualiseerde datacenters. Deze ontwikkeling maakt gebruik van een open source-project genaamd CORD, wat staat voor ‘Central Office Re-architected as Data centre’.

We zien daarbij een transformatie van de traditionele telefooncentrale naar een CORD-datacenter. Dit gebeurt inmiddels in tal van landen en bij talloze telco’s. Naar verwachting zal deze transitie voor 2020 min of meer zijn voltooid. In feite kopiëren de telco’s hierbij de technologie-aanpak van de zogeheten OTT ofwel Over The Top-aanbieders als Facebook, Microsoft, Google en Apple. En dat is ook niet zo vreemd, want het zijn uitgerekend deze aanbieders die de omzet van klassieke telco’s in hoog tempo kannibaliseren. Telco’s kunnen dus alleen met deze OTT-spelers concurreren als zij van een even flexibel technologieplatform gebruik maken.

Vrijwel vanaf dag één zijn de grote banken op Wall Street grote fans van de OCP-aanpak gebleken. Banken als Goldman Sachs en Fidelity kopen inmiddels voornamelijk OCP-servers, waarbij Goldman Sachs zelfs een percentage van 90 haalt als het om het aandeel OCP in de totale aanschaf van servers gaat. Het is wat dat betreft interessant om de koers van de aandelen van traditionele IT-fabrikanten gedurende de afgelopen twee jaar te vergelijken met die van de nieuwe OCP open source-fabrikanten. Zoals zo vaak het geval is bij de opkomst van disruptieve technologie hadden de financiële analisten deze trend minstens een jaar eerder in de gaten dan de meeste mensen die werkzaam zijn in de datacenter-industrie.

Patenten en open source

Om duidelijk te kunnen maken waarom open source het uiteindelijk altijd wint van proprietary oplossingen, wil ik even terug gaan naar de wereld van open source-software. De OCP Foundation doet in feite hetzelfde met hardware als de Linux Foundation (die in 2000 van start ging) gedaan heeft voor open source-software. Vandaag de dag draait Linux op zo’n 90 procent van alle servers die wereldwijd staan opgesteld.

Wat nu zo interessant is, is het feit dat de adoptie van open source-hardware in feite dezelfde groeitrend kent. Onderzoeksbureau IDC verwacht dat in 2020 OCP de basis zal vormen voor 50 procent van de aangeschafte servers. Als die groei doorzet, dan kunnen we er vanuit gaan dat in 2025 80 procent van de hardware in datacenters gebaseerd zal zijn op OCP-designs.

Wie meer wil weten over open source verwijs ik graag naar het boek ‘The Cathedral and the Bazaar: Musings on Linux and Open Source’ door Eric Raymond. Hij analyseert hierin deze tech-trend en draagt zeer overtuigende argumenten aan waarom open source altijd betere en sneller naar de markt komende producten oplevert.

Een belangrijke reden zou wel eens kunnen zijn dat in de wereld van open source geen sprake is van patenten en octrooien. Zo zijn er ook mensen die het succes van Tesla en het internet toeschrijven aan dit fenomeen: geen patenten die innovatie in de weg zitten. In ‘The Zero Marginal Cost Society’ van Jeremy Rifkin wordt bovendien uitgelegd wat vervolgens de macro-economische gevolgen hiervan zijn. We zien overigens momenteel hetzelfde gebeuren rond gedistribueerde energieopwekking.

Mission-critical datacenters

Een terechte vraag die u zich nu misschien stelt is: wat heeft dit allemaal te maken met de energievoorziening, het koelen of het inrichten van een datacenter? Eigenlijk alles. Want de hiervoor beschreven trends betekenen dat open source-projecten de status quo omverwerpen. En dat betekent dus ook: hoe wij tot nu toe de technische infrastructuur van een datacenter ontwerpen.

Laat ik u simpelweg een beeld schetsen van de disruptie waar we in het datacenter mee te maken hebben of gaan krijgen. Wat gaat er onder invloed van OCP uit het datacenter verdwijnen?

- – Centrale UPS-systemen, batterijen en de centrale ruimte waar deze staan opgesteld

- – Verhoogde vloeren

- – Intelligente power strips achter in racks

- – Gereedschap

- – AC/DC-voedingen in servers

- – Ingesleten gewoontes

- – Complexiteit

- – Redundant uitgevoerde hardware

- – Support-technici

- – Hardware-redundantie

- – Verspilling van geld, energie en materiaal

- – Slechte kwaliteit producten

- – Proprietary hardware en vendor lock-in

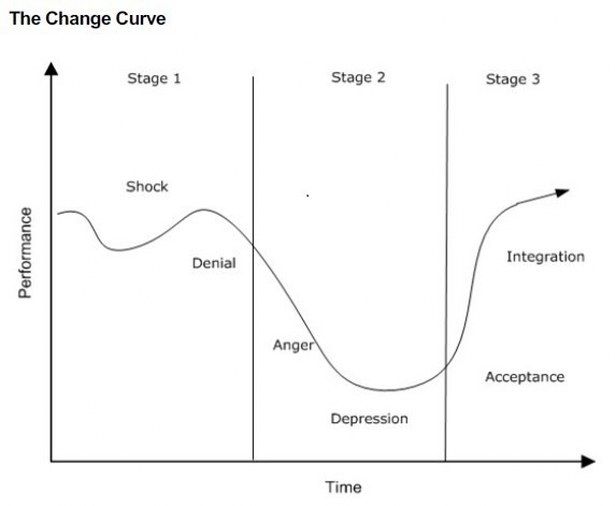

Voor veel ervaren datacenter-specialisten zal dit lijstje er uit zien alsof we uw hobby aan het afnemen zijn. Immers, uw werk is uw hobby en u vindt uw werk uiteraard heel erg leuk. Juist vanwege alle complexiteit en alle ervaring die u in het verleden heeft opgedaan en die veel geld waard is. In figuur 1 heb ik echter de zogeheten Kubler-Ross Change Curve weergegeven die u helpt om te begrijpen waar u persoonlijk staat nu u de wereld van op open source hardware gebaseerde datacenters betreedt.

De Kubler-Ross Change Curve geeft een interessant beeld van de gemoedstoestand van ervaren datacenter-professionals die geconfronteerd worden met de ideeën van Open Compute

De Kubler-Ross Change Curve geeft een interessant beeld van de gemoedstoestand van ervaren datacenter-professionals die geconfronteerd worden met de ideeën van Open Compute

Mijn persoonlijke achtergrond zit - net als velen van u - in het ontwerpen van klassieke datacenters. Nieuwsgierig als ik ben heb ik echter de ontwikkelingen rond OCP vanaf dag 1 gevolgd. Mijn grote Eureka-moment kwam echter pas toen ik via advieswerk dat ik deed voor het Lulea-datacenter van Facebook in Zweden volledig werd ondergedompeld in de OCP-aanpak. Het was voor mij een enorme schok om te zien dat de OCP-aanpak zoveel beter was dan wat ik gewend was. Ik ben persoonlijk al 25+ jaren betrokken bij het ontwerpen en bouwen van datacenters, onder andere als Design Manager bij BT. Daarnaast was ik onder andere lid van het team dat voor Telehouse de eerste datacenter-faciliteiten in de Londense Docklands ontwierp en bouwde. Uit die eerste faciliteiten is het enorme cluster aan datacenters in Londen voortgekomen.

Kunst van het weglaten

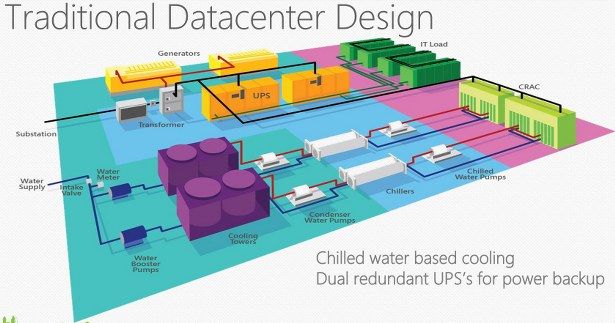

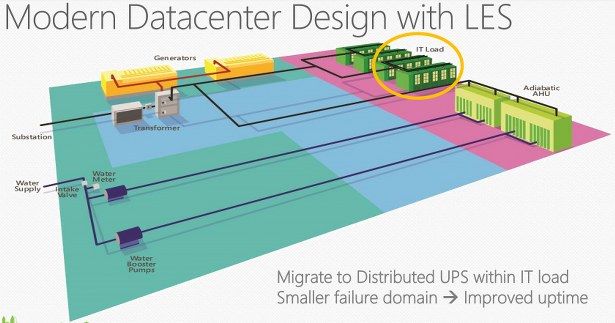

In figuur 2 is een voorbeeld te zien van de energie- en koelingssystemen van een klassiek ontworpen datacenter. Figuur 3 laat zien hoe een OCP-datacenter er uit ziet. Let hierbij vooral op dat in figuur 3 de centrale UPS is verdwenen, net als de mechanische chillers. De Local Energy Store (LES in figuur 3) omvat lithium-ion batterijen (BBU’s ofwel Battery Backup Units) die zijn geïntegreerd met een N+1 gelijkrichters die zich beide in de OCP v2 Open Racks bevinden.

-

3D-schets van een traditioneel ontworpen datacenter

3D-schets van een traditioneel ontworpen datacenter -

Overzicht van een OCP-datacenter met Local Energy Stor

Overzicht van een OCP-datacenter met Local Energy Stor

De figuren 2 en 3 zijn beschikbaar gesteld door Kushagra Vaid, General Manager Microsoft Azure Data Centre Hardware Infrastructure. Doordat in ieder groot datacenter van Microsoft deze componenten zijn weggelaten, heeft dit voor het concern geleid tot een besparing van tientallen miljoenen dollars. Dit ontwerp leidt bovendien tot een significante verbetering van de PUE, die voor nieuwe Microsoft Azure datacenters beter is dan 1,125. Andere grote OCP-datacenters behalen vergelijkbare resultaten. Neem Facebook: 1,08. Overigens publiceert Facebook zijn PUE-waarden.

Ik moet hier eerlijkheidshalve wel aan toevoegen dat deze lage PUE-waardes ook tot stand komen dankzij het gebruik van OCP-servers. Deze servers gebruiken beduidend minder energie dan klassieke systemen. Een nauwgezette analyse van CERN in Zwitserland - dat OCP-servers gebruikt voor HPC ofwel rekenintensieve toepassingen - laat zien dat OCP-servers zo’n 30 procent minder energie verbruiken dan traditionele apparatuur.

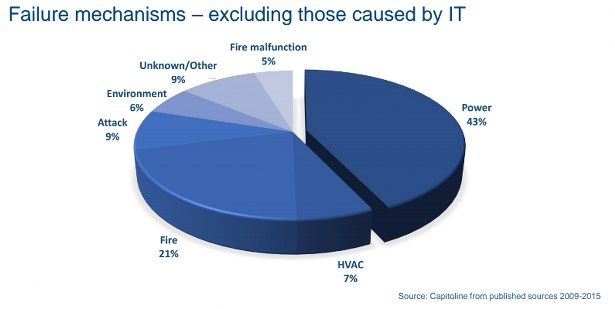

Wat een vergelijking van de figuren 2 en 3 laat zien is dat een OCP-datacenter veel eenvoudiger van opzet is dan een traditioneel ontworpen datacenter. Figuur 4 laat cijfers van het Britse adviesbureau Capitoline zien over storingen in klassieke datacenters. We zien dat ‘power’ een belangrijke bron van storingen is. Daarom heeft OCP doelbewust een veel eenvoudigere structuur voor de energievoorziening gekozen. Vertoont een rectifier of een BBU kuren, dan heeft dit impact op welgeteld één rack. Terwijl een storing van een centrale UPS in een klassiek ontworpen datacenter het functioneren van de complete faciliteit in gevaar kan brengen.

Overzicht van de belangrijkste storingen in datacenters op basis van gegevens verzameld door het Britse adviesbureau Capitoline

Overzicht van de belangrijkste storingen in datacenters op basis van gegevens verzameld door het Britse adviesbureau Capitoline

OCP-servers

Figuur 5 laat zo’n OCP-server zien. Wie goed kijkt naar dit 2U hoge systeem ontdekt meteen dat er geen voeding (PSU of Power Supply Unit) is aangebracht. Een traditionele server zou in veel gevallen twee PSU’s aan boord hebben die beide voor minder dan 40 procent belast worden. Met andere woorden: een energie-efficiency van 80 procent. OCP-servers worden gevoed vanuit een voeding die zich in het rack bevindt. Hierdoor is een beduidend hogere energie-efficiency mogelijk. Het ontwerp dat Google in 2016 hiervoor bij OCP heeft ingediend, kent een energie-efficiency van 97,5 procent. De rectifier unit in het kabinet is gekoppeld aan een 12-volts busbar die zich aan de achterzijde van een OCP v2 Open Rack bevindt.

Voorbeeld van een 2U hoge OCP-server

Voorbeeld van een 2U hoge OCP-server

Aan de achterzijde van de OCP-server zijn twee vrij grote (80 mm diameter) ventilatoren aangebracht die wat energieverbruik veel efficiënter zijn dan de gebruikelijke zes of acht 40 mm fans die normaliter worden gebruikt bij standaard 1U servers. Bovendien biedt een OCP-server door zijn hoogte van 2U ruimte voor veel grotere koeltorens (heat sinks) op de CPU’s. Voeg hierbij de aangepaste lay-out van de elektronica-componenten in de kast en het is duidelijk dat OCP-servers uit de voeten kunnen met veel hogere ingangstemperaturen. En dat betekent weer dat er in een OCP-datacenter geen behoefte is aan mechanische chillers.

Geen gereedschap

OCP-servers worden ook wel ‘ambient servers’ genoemd. Er is veelal geen sprake van grafische chips en ook dat draagt weer bij aan een lager energiegebruik en dus lagere kosten. Bovendien zijn OCP-servers - wat we wel noemen - ‘tool less’. Met andere woorden: zij kunnen geplaatst worden zonder dat hiervoor gereedschap nodig is. Er wordt daarentegen gebruik gemaakt van zogeheten ‘Green Touch Point’. Dit zijn de plekken waar een OCP-server vastgepakt kan worden voor het plaatsen of verwijderen van het systeem. Dit verklaart een ander voordeel dat de internet-scale datacenters erg belangrijk vinden: het aantal technici dat nodig is om servers en andere IT-apparatuur te plaatsen. De zogeheten ‘technician to server node ratio’ staat bij OCP op 1 op 25.000. Met andere woorden: 1 technicus kan 25.000 servers aan. Dat is minimaal 100 maal beter dan bij klassieke enterprise datacenters.

OCP v2 Open Rack

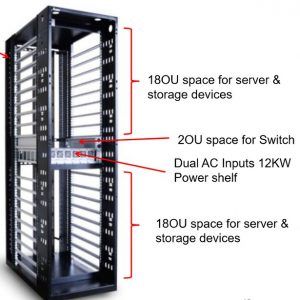

De kreet is al een paar keer in dit artikel gevallen: OCP’s v2 Open Rack. Dit kabinet is te zien in figuur 6. Wat direct opvalt is dat een OCP-rack groter is dan traditionele 19 inch kabinetten. Dit is een gevolg van het feit dat iedere rack ook een lithium-ion batterij en een gelijkrichter omvat. De achterkant van de rack-voeding (de rectifier shelf) is gekoppeld aan een 12-volts DC busbar die zich eveneens aan de achterzijde van het rack bevindt.

Een OCP v2 Open Rack wijkt duidelijk af van klassiek ontworpen kabinetten

Een OCP v2 Open Rack wijkt duidelijk af van klassiek ontworpen kabinetten

De hoogte tussen de verticale rails is wat groter dan we van meer klassieke ontwerpen gewend zijn. Hierdoor kan apparatuur efficiënter geplaatst worden. Dit OCP-ontwerp maakt het mogelijk om vijf 4 inch brede hard disks op te nemen. Ook dat is weer zo’n efficiency-maatregel die veel voordeel oplevert. Een OCP-rack kan hierdoor namelijk 25 procent meer harde schijven bevatten dan we gewend zijn. Deze versie van het OCP-rack kan 1.450 kilogram aan gewicht dragen. Interessant is ook dat deze racks bij de internet-scale partijen veelal volledig met IT-apparatuur gevuld bij een datacenter worden afgeleverd voor ingebruikname.

Kern van de gedachte achter het Open Compute Project is: eenvoud. Zo zijn de datacenters van Facebook volledig op basis van OCP uitgevoerd. Ze bevatten vele miljoenen servers. Desondanks tellen al deze Facebook datacenters maar zeven (!) verschillende rack-configuraties.

John Laban, European representative van de OCP Foundation

Dossiers

Meer over

Lees ook

Global Switch Amsterdam Oost kan nu 30 kW OCP Open Rack Version 3 faciliteren

Datacenterbedrijf Global Switch heeft de OCP Ready-status bereikt voor hun datacenter Amsterdam East. Deze erkenning plaatst Amsterdam East in een nog altijd vrij selecte groep groep van slechts acht colocatie-datacenters in de EMEA-regio die OCP Ready zijn.

OCP introduceert nieuw lidmaatschapsmodel

Het Open Compute Project (OCP) is de afgelopen jaren fors gegroeid. De organisatie telt inmiddels honderden uiteenlopende organisaties, evenals duizenden individuen met verschillende industriële achtergronden en specialisaties als lid. Naar aanleiding van feedback uit diezelfde community heeft OCP besloten een nieuw lidmaatschapsstructuur op te ze1

Open Compute Project annonceert eerste OCP startup-leden

Open Compute Project (OCP) heeft bekend gemaakt dat een eerste groep van startups lid is geworden van de open source hardware-organisatie.